TOPICS

最新情報

-

AIガバナンスを巡る論点2025 ⑩「構造変化モデルでAI社会を見通す」を公開しました。

-

AIガバナンスを巡る論点2025 ⑨ 「AIが揺さぶる安全保障の基盤」を公開しました。

-

「オープンカンファレンス~デジタル政策の論点2026~」開催のお知らせ

-

AIガバナンスを巡る論点2025 ⑧ 「AI時代の報道・・・語れないメディアの窮状」を公開しました。

-

AIガバナンスを巡る論点2025 ⑦ 「ジャーナリズムはslopに駆逐されるのか?」を公開しました。

-

コラム記事#32「デジタル政策2025」谷脇康彦(デジタル政策フォーラム代表幹事)をアップロードしました。

-

コラム記事#31「デジタル主権を巡る欧州と米国の対立」谷脇康彦(デジタル政策フォーラム代表幹事)をアップロードしました。

-

データスペース推進を加速する新たな連携へ 4団体による協業活動の総称「Japan Data Space Alliance (JDSA)」のご案内

デジタル政策フォーラム

コラム

#32 デジタル政策2025

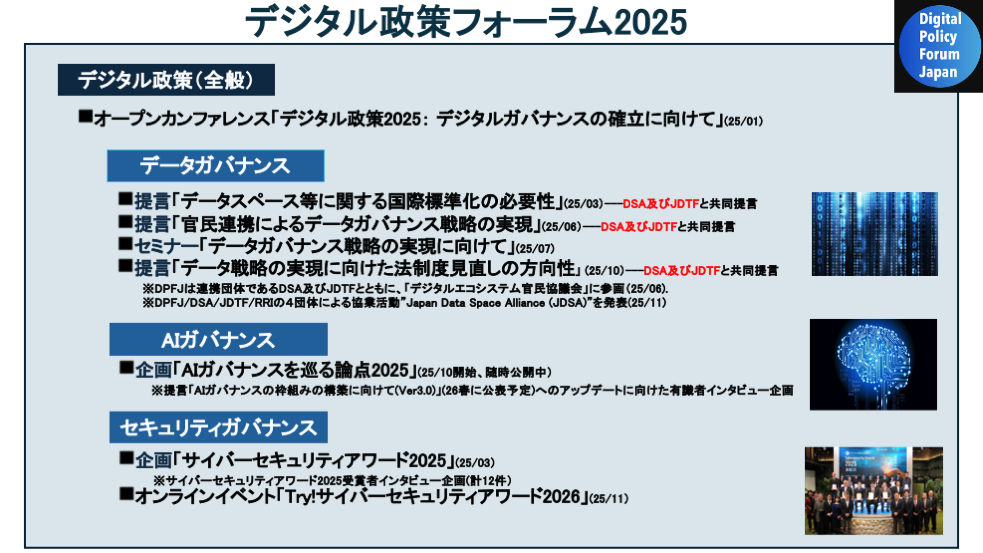

2025年ーデジタル政策の領域は様々な方面で大きく動き、DPFJの活動範囲もさらに広がった。本稿では2025年におけるDPFJの活動を振り返りたい。DPFJではデジタル政策を巡る議論について、「我々はデジタル技術を適切なルールの下で十分に制御できるのか」というデジタルガバナンスの観点で俯瞰的に捉えようと試みてきた。このデジタルガバナンスを巡る議論は、データガバナンス、AIガバナンス、セキュリティガバナンスという3本柱で捉えることができる。

制度整備が進み始めたデータガバナンス

2024年10月、DSA、DPFJ 及び JDTF の三団体は、2024年10月の提言「データガバナンス戦略の推進」[1]に続き、データスペース構築に向けた国際標準化戦略の重要性を内容とする提言「データスペースなどに関する国際標準化の必要性」[2]を公表した。

こうした三団体による複数回にわたる提言や経団連によるデータスペースに関する提言(2024年10月[3]、2025年5月[4])を受け、2025年6月、政府は「デジタル社会の実現に向けた重点計画」[5](以下「重点計画」という)を閣議決定した。

この「重点計画」では「データ連携・利活用推進」という項目及び「データ利活用制度の在り方に関する基本方針」[6](以下「基本方針」という)という章を設けてデータスペース構築に向けた取組内容が盛り込まれている。

上記の基本方針では、 データ連携のための共通基盤について「デジタル公共インフラ」として整備することを方向感として描きながら、データ連携に必要な機能のモジュール化やデータの標準化などを進めるとした上で、全体的な法制度として、「官民データ活用推進基本法の抜本的な改正、新法など必要な検討を行い、次期通常国会に法案を提出することを目指す」という姿勢を明確にした。今後はデータスペースを巡って、総論から各論へと施策の具体化が政府内で進むことが期待される。

こうした政府決定を踏まえ、2025年6月、改めて三団体は提言「データガバナンス戦略の実現に向けて〜政府「デジタル社会の実現に向けた重点計画」の決定を受けて〜」[7]を公表するとともに、政府関係者及び三団体の代表らが参加する公開セミナー「データガバナンス戦略の実現に向けて」[8]を開催した。

三団体はさらに議論を重ね、2025年10月、政府が方針として示した法制度整備において確保すべき事項について整理した提言「データ戦略の実現に向けた法制度見直しの方向性」[9]を発表した。

この提言では、法制度整備に際してはトラストサービス層、データ連携層、データ流通層という三層構造でとらえることを共通認識とすることの重要性や個人情報保護法関連の規律見直しの必要性などが盛り込まれた。

こうした動きの中、三団体はデータスペース構築に向けた官民協議の場として2025年6月に設立された「デジタルエコシステム官民協議会」(事務局はデジタル庁、日本経団連、情報処理推進機構(IPA)の三組織)に参画するとともに、ロボット革命・産業IoTイニシアティブ協議会(RRI)を加えた4団体でデータスペースの社会実装と国際連携を推進する協業活動”Japan Data Space Alliance (JDSA)”を開始することとした。

2026年は政府がデータスペース関連の法案を国会に提出することが見込まれており、こうした動きを注視しつつ、JDSAの活動を通して具体的な制度設計に積極的に取り組んでいきたい。

拡張するAIガバナンス

生成AIの分野ではOpen AIのChat GPT-5(2025年8月)やグーグルのGemini 3(2025年11月)の登場など飛躍的に機能が向上した新バージョンが登場してきており、マルチモーダルな機能の拡充、自動的に複数のタスクを実行するAIエージェントの普及、AIがロボットと連携するフィジカルAIなど新しい動きが急速に広がっている。同時にAIの社会実装も急速に進んでおり、生産性や雇用状況にも具体的な影響が出るようになってきている。

こうしたAIの急速な発展・普及の動向を踏まえ、DPFJはAIガバナンスに関する提言や有識者インタビューを盛り込んだ「AIガバナンスの枠組みの構築に向けて(ver 2.0)」[10]を2024年12月に公表した。

この提言では、法制度のあり方について「ハードローとしてAI基本法を制定することが適当」であり、「AIを巡る政策の基本理念、国等の主体が果たすべき責務、AI戦略の策定、政府におけるAI戦略本部(及び本部府事務局)の権能及び関係機関との連携等について規定することが考えられる」とした。

2025年9月に施行されたAI法[11]は上記提言にほぼ沿った内容となっており、AI戦略本部を設置し、現在、基本戦略及び指針の策定が進められている。

DPFJでは、AI法を巡る国内の議論がひとまず一巡したことを踏まえ、AIが企業経済活動や民主主義プロセスに与える影響、AIの普及と文化・芸術の多様性、AIと宗教の関係性、AIが安全保障戦略に及ぼす影響など、従来の議論の枠を越えた広い範囲を視座に入れつつ第二弾の有識者インタビューを継続しており、2025年10月から企画「AIガバナンスを巡る論点2025」として随時公開している。そして、こうしたインタビュー群と国際的な動向分析を踏まえ、2026年春を目処に「AIガバナンスの構築に向けて(ver 3.0)」を公表することとしている。

深刻化するセキュリティガバナンス

2025年は大手企業が相次いでランサムウェア被害にあって業務支障が長期化するなど、企業経営に直結するような深刻なインシデントが相次いで発生している。こうした中、サイバー対処能力強化法が成立、2025年5月公布された。

この法律はサイバー攻撃の兆候を捉えた段階で無害化する能動的サイバー防御(active cyber defense)を導入することにある。実際にこうした防御を行うことが可能となるのは法律が全面施行される2026年末以降となるが、こうした制度整備は日本のサイバーセキュリティ対策を官民連携の下で前に進めていく上で「大きな一歩」だと言える。

このように深刻なインシデントの発生等が急増する中、サイバー空間の脅威を的確に把握し対策を講じ、評価するための管理手法(ガバナンス)にも関心が集まっている。こうした中、サイバーセキュリティ関連のコンテンツが増え始めている。

そこで、DPFJはサイバーセキュリティに関する初学者向けの優秀なコンテンツを表彰する「サイバーセキュリティアワード」を創設した。書籍、ウェブコンテンツ、フィクション、企画の4部門で構成されており、2025年3月には第二回目となるアワードの表彰式が行われた[12]。

本アワードはこうした表彰されたコンテンツの関係者たちのコミュニティ形成の場としても貢献することを目指しており、同年度の受賞者へのインタビュー12件がDPFJのウェブサイトで公開された[13]。DPFJでは2026年3月、第三回目となるアワード授賞式を開催することとしている。

分断化が進むサイバー空間

2025年は主要国におけるデジタル政策の方向性の違いが顕著に現れた1年だった。サイバー空間を巡る議論において、これまでは米欧日など旧西側諸国と中露の対立軸(東西対立)が明確だったが、この1年は特に米国と欧州の間の亀裂が大きく広がった点に特徴がある[14]。

まず米国からみてみよう。2025年に誕生したトランプ第二期政権は、各国に対する追加関税を賦課し、バーター条件として米国に有利な制度見直し等を獲得しようとするものとなっている。これは貿易の自由化と公平な貿易環境を促進するWTO(世界貿易機関)という国際的な枠組みの価値を毀損した。自国中心(America first)の産業政策を進め、米国政府によるインテルへの10%出資、官民協働のAI基盤であるASSP(American Science and Security Platform)を活用した新技術開発(Genesis Mission)、欧州デジタル関連法(例えばDMA)に対する非難を含む国家資本主義的な動き、FCC(連邦通信委員会)などの独立規制機関に対する人事介入など三権分立の礎を危うくする動き[15]、DEI(Diversity, Equality and Inclusion)に基づく生成AIを連邦政府の調達対象から外すイデオロギー中立性(ideological neutrality)を軸とする「バイアスのないAI原則」(unbiased AI principles)など、デジタル政策に関わる領域だけでも、これまで考えられなかったような動きが出てきている。

一方の欧州はどうか。GDPRやDMAのようなデジタル関連法によって米国プラットフォーマーの影響を脱することを目指したものの、その効果に限りがあると判断した欧州は、2024年9月に公表されたEUの競争力強化を目指す「ドラギレポート」に基づき、欧州独自の技術開発を進めるScaleup Euro Fundの設立(50億ユーロ規模との報道)、欧州企業そのものにも負担を強いているデジタル法制に関する手続き緩和(AI法の完全施行の延期を含む“デジタルオムニバス”の提案)など、米国とは立ち位置が大きく異なるものの、国家資本主義的な動きを強めているように見える。

2026年のデジタル政策はサイバー空間における東西対立や米欧対立、さらに途上国におけるサイバー主権強化の動きなど、技術的な観点からみたデジタル政策だけではなく、国家体制そのもののあり方とデジタル政策が一体化しつつ議論がさらに複雑化していくことになるだろう[16]。

[1] https://www.digitalpolicyforum.jp/archive/promoting-a-data-governance-strategy20241017/

[2] https://www.digitalpolicyforum.jp/archive/2503_dss_jp/

[3] https://www.keidanren.or.jp/policy/2024/073.html

[4] https://www.keidanren.or.jp/policy/2025/026.html

[5] https://www.digital.go.jp/policies/priority-policy-program

[6] https://www.cas.go.jp/jp/seisaku/digital_gyozaikaikaku/pdf/data_houshin_honbun.pdf

[7] https://prtimes.jp/main/html/rd/p/000000016.000131931.html

[8] https://www.digitalpolicyforum.jp/archive/opcf-to-realize-a-data-governance-strategy/

[9] https://www.digitalpolicyforum.jp/wp-content/uploads/2025/10/10%E6%9C%88%E6%8F%90%E8%A8%80.pdf

[10] https://www.digitalpolicyforum.jp/column/241206/

[11] 正式名称は「人工知能関連技術の研究開発及び活用の推進に関する法律」。

[12] https://csa.digitalpolicyforum.jp/award-report/award-report-2025.html

[13] https://csa.digitalpolicyforum.jp/award_interview/index.html

[14] 谷脇康彦「デジタル主権を巡る欧州と米国の対立」(DPFJコラム、2025年12月) https://www.digitalpolicyforum.jp/column/251125/

[15] 谷脇康彦「トランプ大統領と独立規制機関」(DPFJコラム、2025年3月) https://www.digitalpolicyforum.jp/column/250318/

[16] 谷脇康彦「デジタル政策を検証する(2025年夏)」(DPFJコラム、2025年8月) https://www.digitalpolicyforum.jp/column/250826/